1. Авторские права

Первая зона риска – авторские права. В Российской Федерации ключевым нормативным актом является Гражданский кодекс РФ (часть IV), а также международные соглашения, участником которых является Россия. Генеративные модели обучаются на огромных массивах данных, среди которых могут быть защищённые произведения (тексты, изображения, музыка и др.). Если результат ИИ повторяет чужие изображения или тексты, это может считаться нарушением авторских прав. Например, недавно мы обсуждали использование фото без разрешения авторов, основные правовые аспекты, касающиеся защиты правообладателей, и меры профилактики для предпринимателей, желающих обезопасить себя от исков, связанных с незаконным использованием чужого контента.

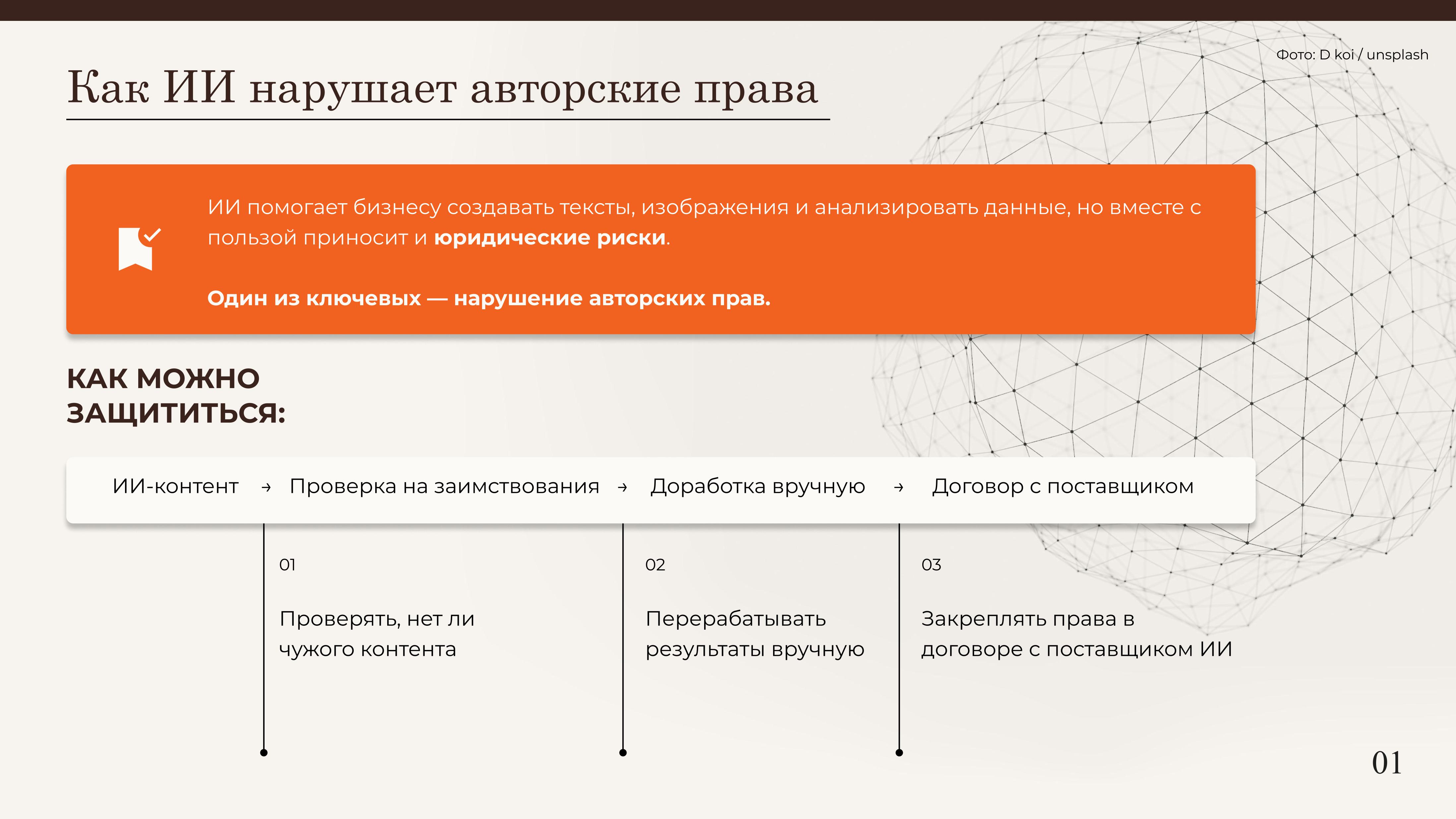

При публикации или коммерческом использовании контента, созданного ИИ, рекомендуется:

- проверять, не содержит ли материал фрагменты чужих произведений;

- при необходимости перерабатывать контент вручную;

- фиксировать в договоре с ИИ-поставщиком, что все права на результаты остаются у вас, а данные не используются для обучения моделей без вашего согласия.

2. Персональные данные

Вторая зона риска – персональные данные. Любая обработка информации о клиентах и сотрудниках регулируется Федеральным законом № 152-ФЗ «О персональных данных».

В соответствии с действующим законодательством, оператор обязан обеспечить безопасность персональных данных, обрабатывать их только на законных основаниях (ст. 6 ФЗ № 152-ФЗ) и предоставлять субъектам возможность реализовывать права, которыми они наделены – например, на доступ, исправление, блокирование и удаление.

Таким образом, если ИИ-система, которой пользуется компания, осуществляет автоматизированную обработку данных (например, анализ профилей клиентов или автоматическое принятие решений), организация обязана:

- иметь законное основание для обработки (согласие субъекта или иное основание, предусмотренное законом);

- применять технические и организационные меры защиты (шифрование, псевдонимизация);

- обеспечить прозрачность алгоритма и возможность «человеческого надзора».

В 2024 году был принят Федеральный закон № 233-ФЗ от 8 августа 2024 года, который внёс изменения в ФЗ № 152-ФЗ «О персональных данных» и ввёл понятие обезличенных (псевдонимизированных) персональных данных для формирования наборов данных (датасетов) в государственных информационных системах. Нововведения обязывают операторов предоставлять обезличенные персональные данные в государственные информационные системы по запросу уполномоченных органов, если это необходимо для аналитических и исследовательских целей. Согласно части 3 статьи 13.1 ФЗ № 152-ФЗ, обезличивание – это «действия, в результате которых становится невозможным определить принадлежность персональных данных конкретному субъекту без использования дополнительной информации».

Таким образом, использование подобных данных для обучения ИИ возможно только при одновременном соблюдении двух условий:

- наличие законного основания для их обработки;

- обеспечение защиты информации от несанкционированного доступа или повторной идентификации.

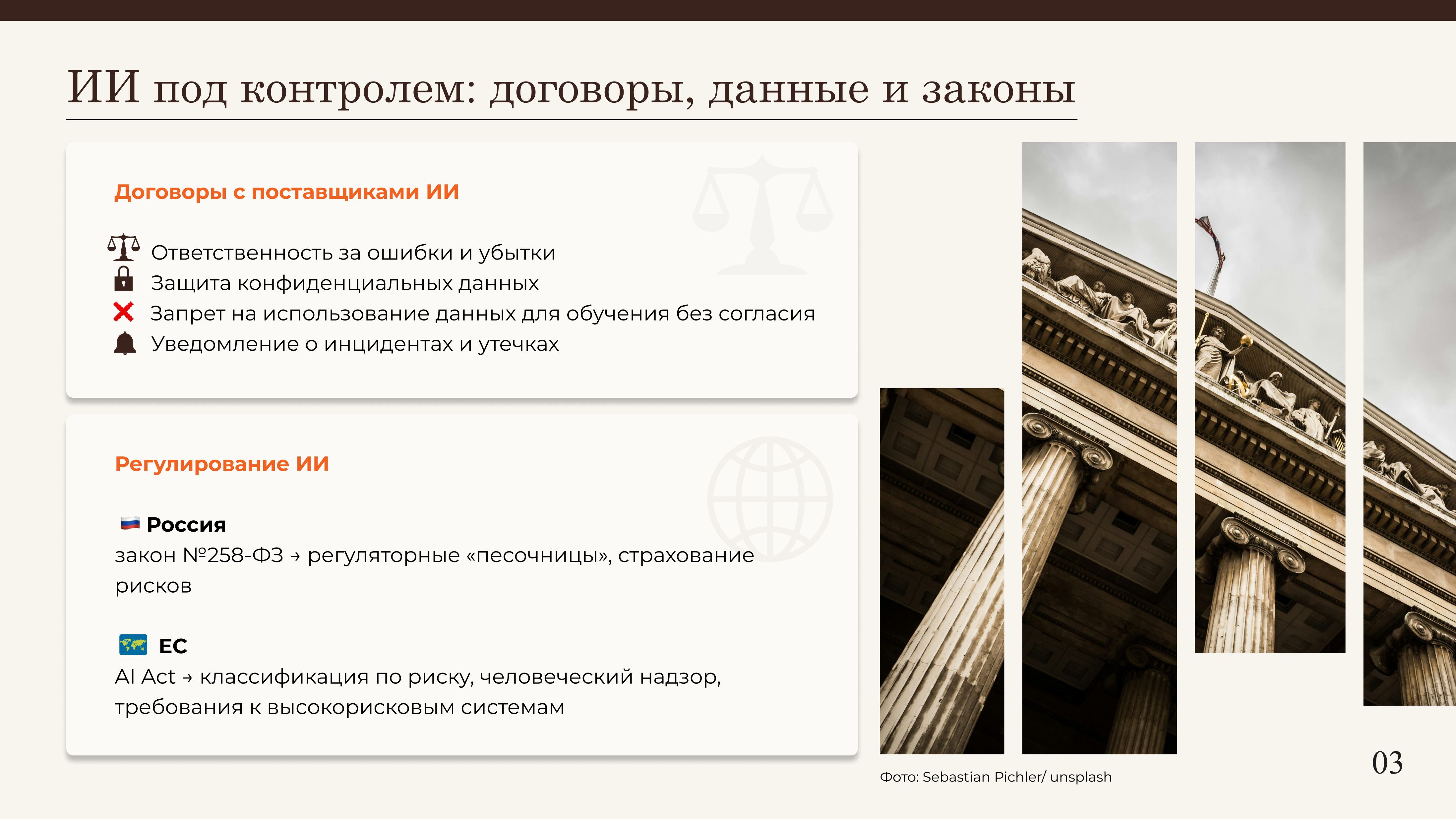

3. Договоры с поставщиками ИИ-сервисов

Третья зона риска – договорные отношения с поставщиками ИИ-сервисов.

Если компания пользуется внешними платформами (например, генераторами текста, изображений или аналитических систем), важно заранее определить:

- кто несёт ответственность за ошибки или убытки, вызванные ИИ;

- как обеспечивается конфиденциальность данных;

- в каких случаях поставщик вправе использовать ваши данные для дальнейшего обучения моделей.

В договоре рекомендуется прописать:

- прямой запрет на использование ваших данных для обучения без согласия;

- обязательства по защите данных и соблюдению законодательства;

- распределение ответственности в случае нарушения прав третьих лиц;

- порядок уведомления о выявленных инцидентах или утечках.

Указанные меры профилактики снижают риск конфликтов и юридических претензий, если ИИ-платформа допустит ошибку.

4. Регулирование ИИ

Четвёртая зона риска – регулирование ИИ в целом. В России действует Федеральный закон № 258-ФЗ «Об экспериментальных правовых режимах в сфере цифровых инноваций». Он позволяет компаниям тестировать новые технологии, включая ИИ, в так называемых «регуляторных песочницах», где допускается временное смягчение некоторых требований законодательства.

Поправки, внесённые Законом № 169-ФЗ от 8 июля 2024 года, уточнили порядок установления таких режимов и добавили обязанность страхования рисков при проведении экспериментов.

На международном уровне значительным событием стало принятие Регламента ЕС № 2024/1689 (AI Act), вступившего в силу в 2024 году. Документ вводит классификацию систем ИИ по уровням риска (от минимального до высокого и недопустимого) и устанавливает строгие требования к высокорисковым системам.

Так, статья 14 AI Act закрепляет обязанность обеспечивать «эффективный человеческий надзор» над алгоритмами, а статья 6 – определяет критерии отнесения систем к высокому риску.

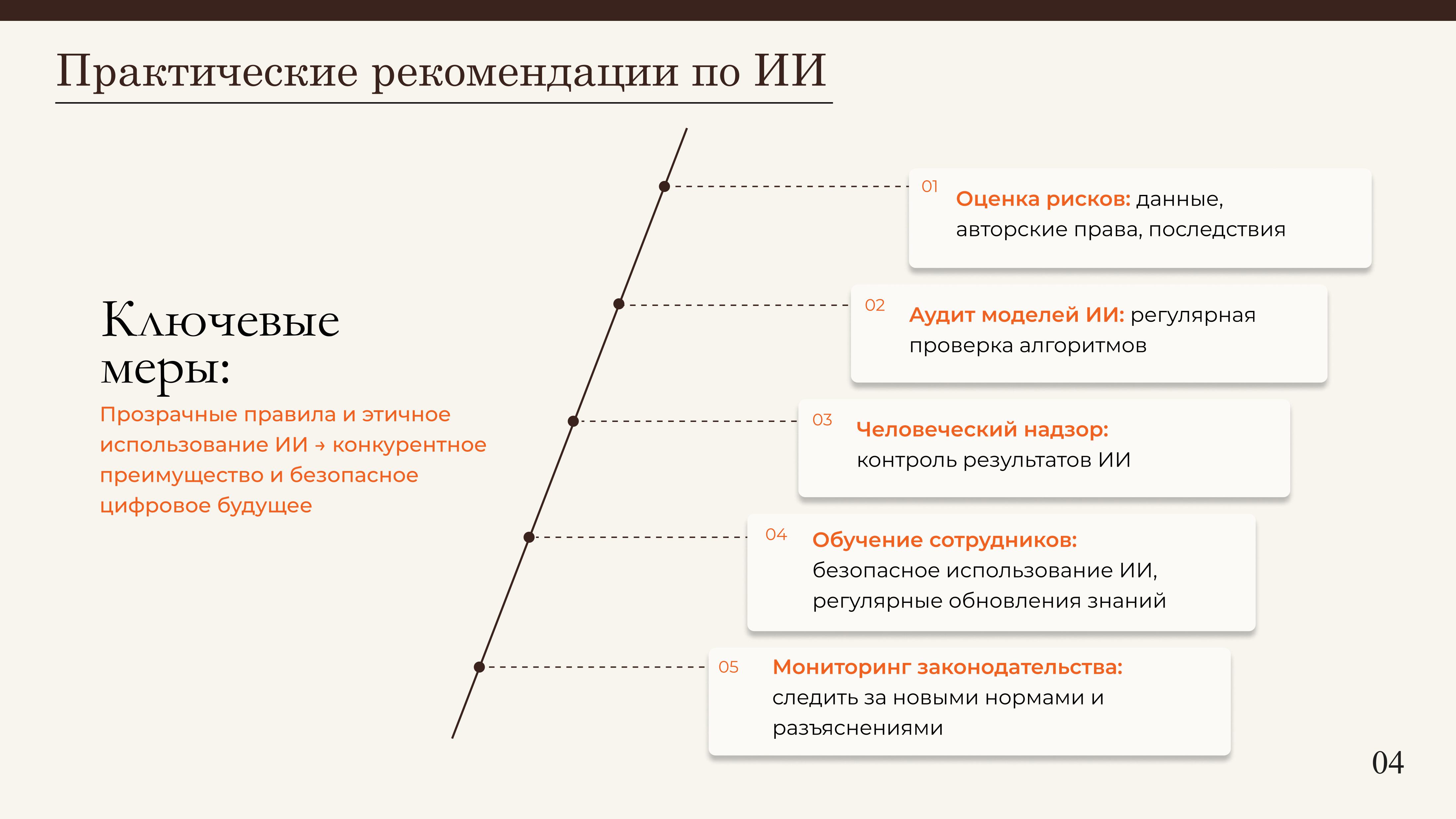

5. Практические рекомендации

Чтобы защитить бизнес, важно выстроить внутреннюю политику ответственного использования ИИ.

В числе мер профилактики:

- проведение оценки рисков: какие данные используются, есть ли авторские права, каковы возможные последствия;

- использование обязательного «человеческого надзора» за результатами работы алгоритмов;

- обучение сотрудников правилам безопасного обращения с ИИ-сервисами и постоянное обновление этих знаний по мере развития ИИ;

- регулярное проведение аудита моделей ИИ;

- мониторинг законодательных нововведений и разъяснений контролирующих органов.

ИИ – мощный инструмент, способный ускорить бизнес-процессы и улучшить качество решений. Но без должной предусмотрительности и юридической поддержки легко нарушить закон, пусть даже непреднамеренно. Сегодня правовое регулирование ИИ в России и мире стремительно развивается, поэтому компании, которые выстраивают прозрачные правила использования инноваций, получают конкурентное преимущество. Внимательное отношение к действующим требованиям и этичное обращение с данными, ответственное использование технологий и внимание к деталям – фундамент устойчивого и безопасного цифрового будущего.

Уполномоченный по защите прав предпринимателей в Петербурге

Уполномоченный по защите прав предпринимателей в Петербурге  Президент Ассоциации фермеров Ленобласти и Петербурга

Президент Ассоциации фермеров Ленобласти и Петербурга  Председатель совета «Городского объединения домовладельцев»

Председатель совета «Городского объединения домовладельцев»  Архитектор, руководитель проекта «Центр развития комфортной городской среды»

Архитектор, руководитель проекта «Центр развития комфортной городской среды»